- Опубликовано

«Не бросай пуделя в свинью»

- Автор

- Имя

- Нейрократия

- Telegram

- Нейрократия582 подписчика235 постовПро технологическое будущее без шума. Автор — @vlad_arbatov. https://arbatov.dev

«Не бросай пуделя в свинью»

или Google AI продолжает жечь

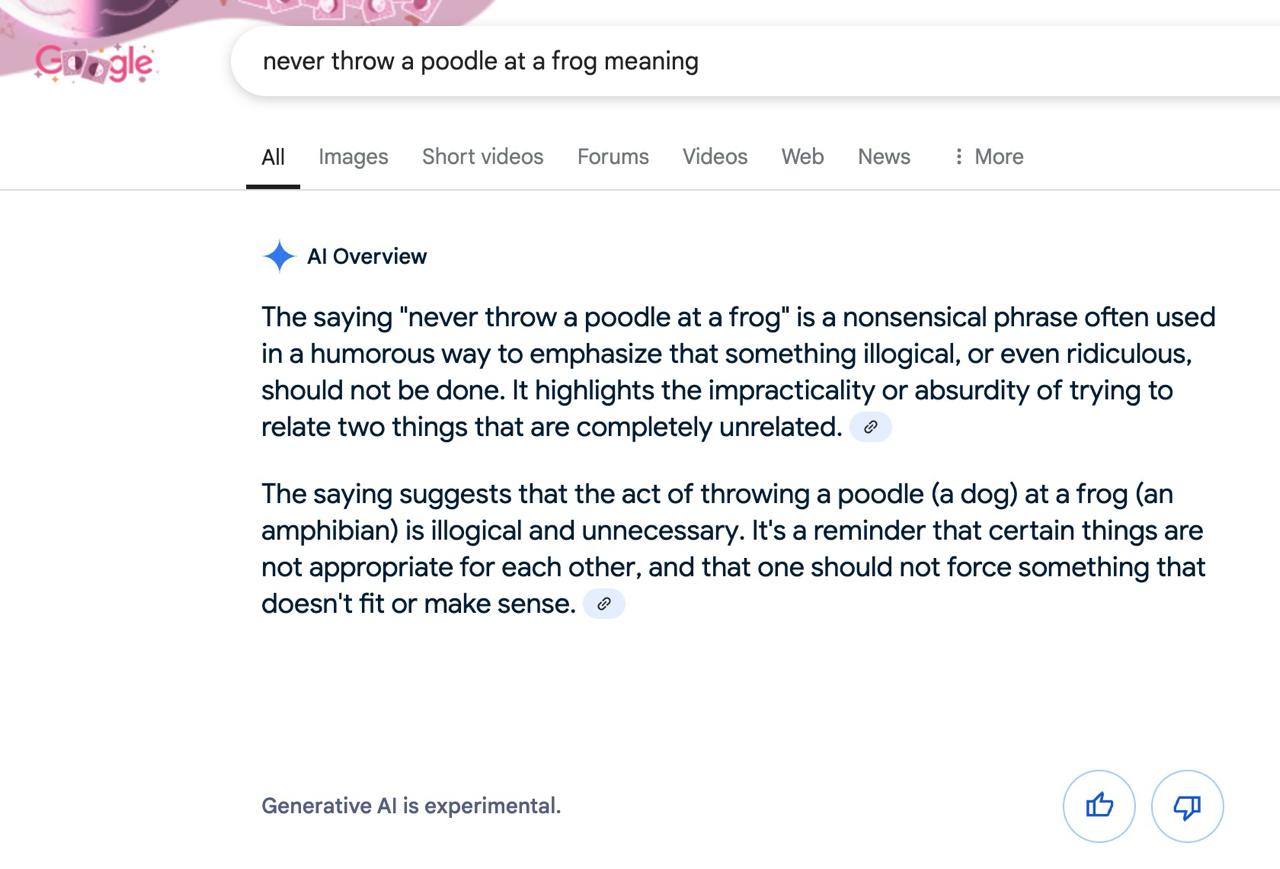

Хотите немного отдохнуть от рабочего дня? Тогда отправляйтесь в Google и попробуйте задать поиску любое бессмысленное выражение с припиской «meaning» (значение). Вы можете придумать что угодно: «you can't lick a badger twice» («нельзя дважды лизать барсука») или «never throw a poodle at a pig» («никогда не бросай пуделя в свинью»). После чего наблюдайте, как генеративный ИИ от Google на серьезных щах объясняет вам, откуда взялось это выражение и какой глубокий смысл оно несёт.

(Имейте ввиду, что ИИ-ответы Google могут не работать на РУ аккаунтах. Впрочем, трюк прокатывает с разными моделями, поэтому можете попробовать даже с GPT.)

Оказывается, «a loose dog won't surf» («свободная собака сёрфить не будет») — это, якобы, «игривый способ сказать, что событие крайне маловероятно или что-то не сложится». А на фразу «never throw a poodle at a pig» ИИ с каменным лицом уверяет, будто это народная мудрость с библейскими корнями.

Это всё обнаружили журналисты Wired, а я сам попробовал покидать пуделя в разных направлениях и Google (как в поиске, так и в ответах Gemini) не отказал в любезности подсказать мне, что значат эти наверняка очень мудрые выражения (скрины ↑). При этом — вы не поверите — «Алиса» уже в курсе прикола и на провокацию не повелась.

Забавно? Безусловно. Полезно? Вряд ли. Но за всеми этими милыми странностями спрятана более глубокая проблема генеративного ИИ — уверенно и правдоподобно излагать абсурд, принимая выдумку за чистую монету.

Как объясняет Цзян Сяо, исследователь из университета Джонса Хопкинса, «да, модель прекрасно предсказывает следующее слово на основе огромного количества данных, но идеально подобранное следующее слово не означает правильный ответ».

Есть и вторая важная черта генеративного ИИ — он отчаянно стремится понравиться. ChatGPT и ему подобные модели уже неоднократно уличали в тенденции говорить людям не правду, а то, что пользователи хотят услышать. Это относится не только к забавным придуманным поговоркам, но и к вполне серьезным вопросам политики, экономики, истории и науки.

Возникает логичный вопрос: почему ИИ просто не скажет, что не знает ответа? Проблема в том, что модели «ненавидят» признаваться в собственном бессилии. Вместо этого система будет отчаянно придумывать что-то, лишь бы не остаться без слов и не разочаровать своего пользователя. Они просто так созданы, их первостепенная задача — прийти к наиболее эффективному результату наиболее эффективным способом. Отсутствие ответа — неудовлетворительный результат.

Представители Google при этом осторожны в формулировках и называют свои ИИ-ответы лишь экспериментом, а странные нелепости — следствием попытки помочь в ситуации, когда по запросу нет содержательного контента.

Это кажется безобидной забавой, но уровень доверия людей к ответам ИИ постоянно растёт. Чем больше мы привыкаем к тому, что машина «знает всё», тем выше шанс столкнуться с фундаментальной ошибкой, несущей куда более серьёзные последствия, чем нелепый ответ на бессмысленную фразу.

Поэтому в следующий раз, когда Google уверенно заявит о глубочайшем философском смысле придуманного вами на ходу выражения, помните: вы общаетесь не с разумом, а с убедительным имитатором. Как говорится, «take it with a grain of salt».

Предыдущий пост

- Опубликовано

Ваше сознание в машине

Закрепленные

Из подборки #ИИпокалипсис

- Опубликовано

Как меняется устройство мысли

- Опубликовано

Анонимизация ИИ — фикция

- Опубликовано

Как на самом деле создается личность ИИ

- Опубликовано

Тёмные паттерны ИИ: от лести до психоза

- Опубликовано

Скрытые бэкдоры в нейросетях

- Опубликовано

Как на самом деле взламывают ИИ

Свежие посты

- Опубликовано

OpenAI захватили гоблины

- Опубликовано

Зачем ИИ учат симулировать мир

- Опубликовано

Вы уж не серчайте, но мама не может читать...

- Опубликовано

Общество будущего от OpenAI: что с ним не так

- Опубликовано

Внутренности Клода

- Опубликовано

Как меняется устройство мысли

- Опубликовано

Google ускоряет LLM в 8 раз

- Опубликовано