- Опубликовано

Google создал эволюцию алгоритмов в реальном времени

- Автор

- Имя

- Нейрократия

- Telegram

- Нейрократия582 подписчика235 постовПро технологическое будущее без шума. Автор — @vlad_arbatov. https://arbatov.dev

Google создал эволюцию алгоритмов в реальном времени

Из лабораторий Google DeepMind снова вылетело технологическое чудо. Их новый инструмент, AlphaEvolve, использует семейство языковых моделей Gemini 2.0, чтобы генерировать и многократно улучшать программы. Если раньше подобные системы могли лишь составлять небольшие куски кода, то AlphaEvolve способен создавать полноценные алгоритмы в сотни строк — и не просто создавать, а находить решения, превосходящие по эффективности и точности лучшее, что могут предложить разработчики-человеки.

И это не какие-то абстрактные математические упражнения (хотя с ними тоже всё отлично), а совершенно реальные задачи, на которых основаны крупнейшие инфраструктуры планеты:

🔸 Конкретное достижение AlphaEvolve — улучшение алгоритма распределения задач по серверам Google. Новый подход, придуманный моделью, уже внедрен во всех дата-центрах компании больше года назад и высвободил 0,7% всех вычислительных ресурсов. Кажется мало? В масштабе Google — это экономия десятков миллионов долларов ежегодно.

🔸 AlphaEvolve фактически сделал математические открытия — нашел новый, самый быстрый метод умножения матриц. Здесь модель побила предыдущий рекорд AlphaTensor (другой разработки DeepMind). Причём, если AlphaTensor был заточен строго под бинарные матрицы (состоящие только из 0 и 1), AlphaEvolve решил задачу для любых чисел, сократив количество скалярных умножений с 49 до 48, что стало первым прогрессом с момента алгоритма Страссена 1969 года.

→ Математические результаты AlphaEvolve доступны в открытом виде в Colab.

🔸 Модель улучшила расход энергии специализированных TPU-чипов Google, оптимизиров реализацию Verilog и удалив ненужные биты, а также ускорила ядра умножения матриц на 23%, что сократило общее время обучения тех же моделей Gemini на 1% (это прилично, на самом деле), и сократила время оптимизации с месяцев до дней.

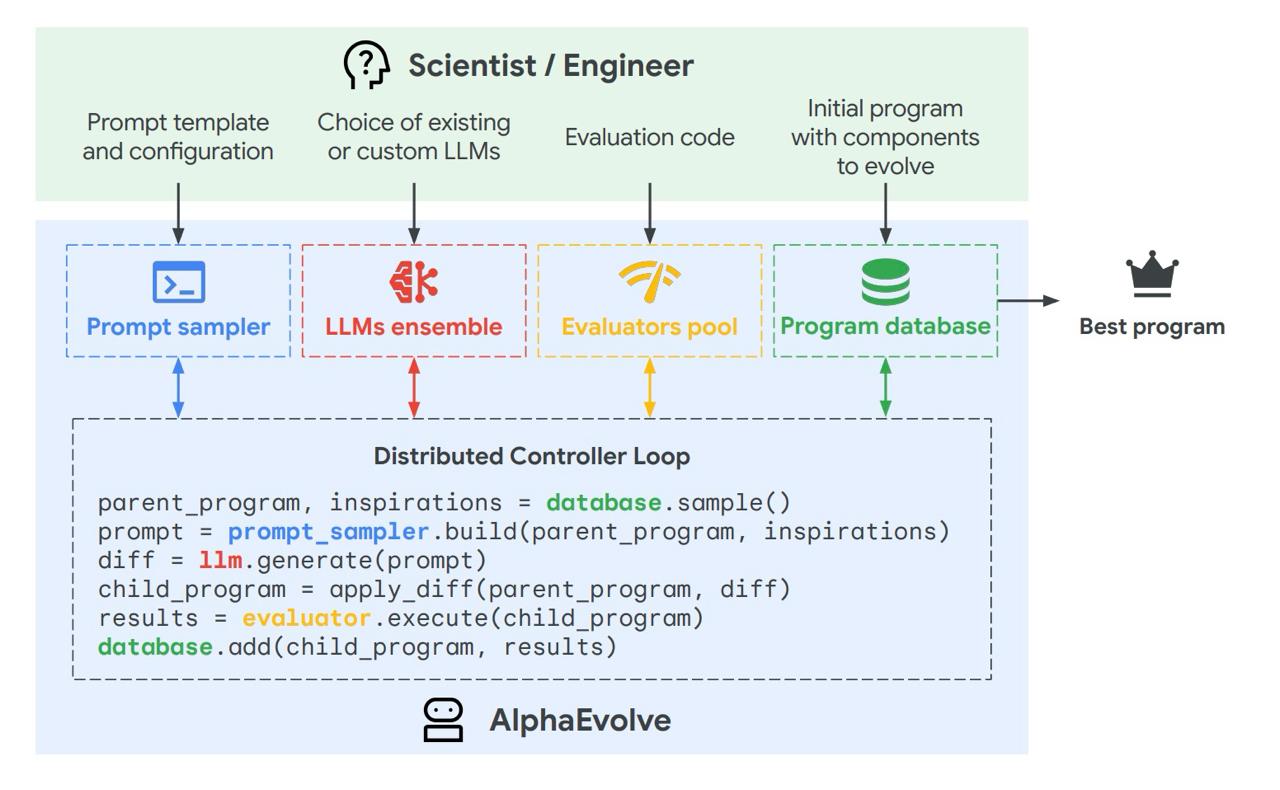

Как AlphaEvolve это делает?

1. Пользователь подробно описывает задачу модели, включает примеры старых решений.

2. Быстрая LLM-версия Gemini Flash генерирует десятки стартовых алгоритмов.

3. Система тестирует все эти идеи, оценивая их точность и эффективность.

4. Лучшие куски кода дорабатываются и комбинируются, а худшие — отбрасываются.

5. Если Flash исчерпывает свои идеи, на помощь приходит мощный Gemini Pro.

6. Цикл повторяется, пока модель не упрётся в предел возможного (для себя, естественно).

По сути, это естественный отбор алгоритмов в режиме реального времени — только побеждает здесь не самый приспособленный организм, а самый эффективный код. Это эволюционный подход, вдохновленный алгоритмами вроде MAP elites и модели островных популяций, для эволюции целых файлов кода, а не только отдельных функций

AlphaEvolve не просто ищет решение конкретной задачи, он создаёт целый способ её решения, находя новый алгоритмический подход, о котором никто не задумывался раньше.

Понятное дело, есть и недостаток: решение AlphaEvolve часто непрозрачно. Мы не полностью понимаем, почему модель пришла именно к такому решению. Но, возможно, это малая цена за возможность решать задачи, над которыми человеки ломали голову десятилетиями.

Предыдущий пост

- Опубликовано

Кризис оценки: как социология может помочь в тестах ИИ

Следующий пост

- Опубликовано

Ляпы про ИИ в кино

Закрепленные

Из подборки #обзор

- Опубликовано

AI 2025: агенты, ролплей, китайская экспансия

- Опубликовано

Чем больше LLM, тем легче её взломать

- Опубликовано

OpenAI пытается отучить модели врать

- Опубликовано

Как ИИ создаёт видео: разбираем технологию

- Опубликовано

Activepieces: новый n8n?

- Опубликовано

Anthropic запустила образовательные курсы

Свежие посты

- Опубликовано

OpenAI захватили гоблины

- Опубликовано

Зачем ИИ учат симулировать мир

- Опубликовано

Вы уж не серчайте, но мама не может читать...

- Опубликовано

Общество будущего от OpenAI: что с ним не так

- Опубликовано

Внутренности Клода

- Опубликовано

Как меняется устройство мысли

- Опубликовано

Google ускоряет LLM в 8 раз

- Опубликовано